攜程日處理20億數(shù)據(jù) 實時用戶行為服務(wù)系統(tǒng)架構(gòu)實踐

在當今數(shù)據(jù)驅(qū)動的時代,攜程作為行業(yè)領(lǐng)導者,每天需要處理高達20億條的用戶行為數(shù)據(jù)。這一龐大的數(shù)據(jù)量不僅涉及用戶搜索、瀏覽、預訂等核心業(yè)務(wù)場景,還包括實時的反饋與交互。為了高效支持這些數(shù)據(jù)處理需求,攜程構(gòu)建了高度優(yōu)化的實時用戶行為服務(wù)系統(tǒng)。該系統(tǒng)架構(gòu)的實踐,體現(xiàn)了從數(shù)據(jù)采集、處理到應用的全鏈路創(chuàng)新,確保數(shù)據(jù)處理的及時性、準確性和可擴展性。

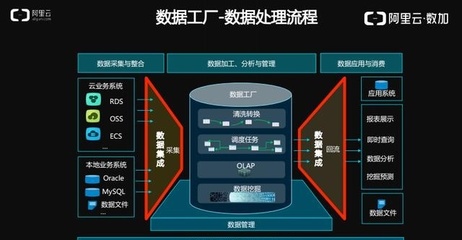

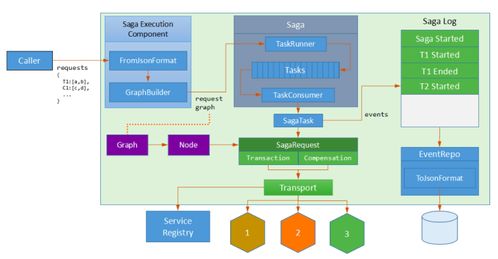

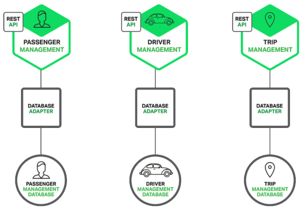

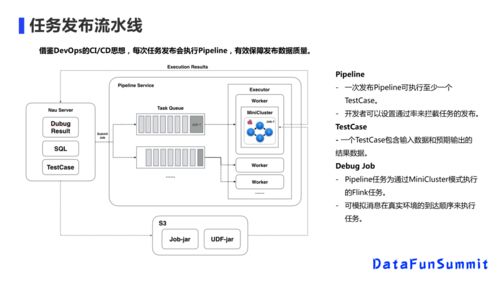

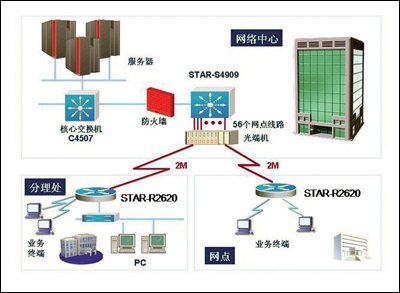

系統(tǒng)架構(gòu)的核心在于分層設(shè)計。數(shù)據(jù)采集層利用分布式日志收集工具(如Kafka)和代理服務(wù),實時捕獲用戶行為事件,確保數(shù)據(jù)源的完整性和低延遲。中間的數(shù)據(jù)處理層是關(guān)鍵,它采用流式計算框架(如Apache Flink)進行實時清洗、聚合和轉(zhuǎn)換。通過微服務(wù)化的數(shù)據(jù)處理模塊,系統(tǒng)能夠動態(tài)分配計算資源,應對峰值流量,同時保證高可用性。例如,用戶的一次點擊行為,從發(fā)生到進入分析數(shù)據(jù)庫,僅需毫秒級時間,這得益于流水線式的并行處理機制。

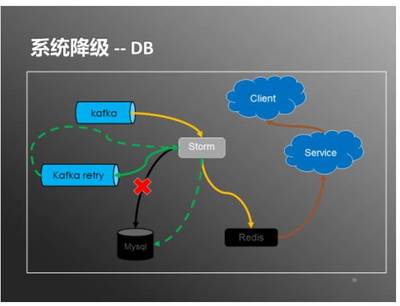

系統(tǒng)在數(shù)據(jù)處理服務(wù)中引入了智能路由和容錯機制。數(shù)據(jù)會根據(jù)業(yè)務(wù)類型被路由到不同的處理隊列中,避免單點瓶頸。同時,通過監(jiān)控和自動重試策略,系統(tǒng)能夠快速從故障中恢復,確保數(shù)據(jù)不丟失。例如,在節(jié)假日流量激增時,系統(tǒng)通過彈性伸縮和負載均衡,平穩(wěn)處理了超過日常兩倍的請求量。

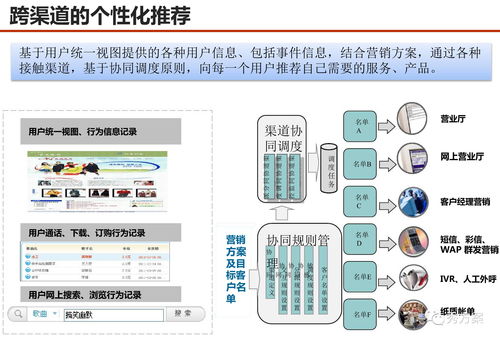

系統(tǒng)架構(gòu)還包括了存儲和查詢優(yōu)化。處理后的數(shù)據(jù)被存入分布式數(shù)據(jù)庫(如Elasticsearch和HBase),支持實時查詢和離線分析。通過數(shù)據(jù)分區(qū)和索引策略,用戶行為數(shù)據(jù)可以被快速檢索,為個性化推薦和風險控制提供支持。例如,攜程的推薦引擎利用這些實時數(shù)據(jù),動態(tài)調(diào)整展示內(nèi)容,提升了用戶轉(zhuǎn)化率。

系統(tǒng)的成功實踐離不開持續(xù)監(jiān)控和優(yōu)化。攜程團隊建立了全面的指標監(jiān)控體系,包括數(shù)據(jù)處理延遲、錯誤率和資源利用率,通過A/B測試和性能調(diào)優(yōu),不斷改進架構(gòu)。這種迭代式的開發(fā)方法,使得系統(tǒng)能夠適應業(yè)務(wù)快速增長,同時控制成本。

攜程的實時用戶行為服務(wù)系統(tǒng)架構(gòu)是一個集高效、可靠和智能于一體的典范。它不僅支撐了日常海量數(shù)據(jù)處理,還為未來AI驅(qū)動業(yè)務(wù)奠定了基礎(chǔ)。這一實踐為行業(yè)提供了寶貴經(jīng)驗:在構(gòu)建大規(guī)模數(shù)據(jù)處理系統(tǒng)時,需注重分層設(shè)計、實時流處理和彈性擴展,以實現(xiàn)數(shù)據(jù)價值最大化。

如若轉(zhuǎn)載,請注明出處:http://www.qmxyk.cn/product/23.html

更新時間:2026-04-08 13:34:27